中科院软件所四项成果被人机交互顶级会议CHI 2019长文接收

文章来源:1. 人机交互技术与智能信息处理实验室 | 发布时间:2018-12-17 | 【打印】 【关闭】

ACM CHI (ACM CHI Conference on Human Factors in Computing Systems)是人机交互领域顶级国际学术会议,也是中国计算机学会认定的A类会议。CHI 2019将于5月4号到9号在英国格拉斯哥举行,大会共收到论文投稿2960篇,最终录用率约为23.8%。

在国家重点研发计划“云端融合的自然交互设备与工具”项目支持下,中科院软件所田丰研究员团队在智能交互、辅助诊断、虚拟现实等方面与国内外合作者共同开展了一系列研究工作,其中4篇长文《What Can Gestures Tell? Detecting Motor Impairment in Early Parkinson’s from Common Touch Gestural Interactions》、《SmartEye: Assisting Instant Photo Taking via Integrating User Preference with Deep View Proposal Network》、《PinchList: Leveraging Pinch Gestures for Hierarchical List Navigation on Smartphones》、《Crossing-Based Selection with Virtual Reality Head-Mounted Displays》被CHI 2019接收,并将在大会上作口头报告。

1. What Can Gestures Tell? Detecting Motor Impairment in Early Parkinson’s from Common Touch Gestural Interactions

帕金森病是常见的神经系统损伤疾病,在人类社会老龄化问题逐渐严重的今天,该疾病在全世界范围发病率呈上升趋势。运动功能是诊断帕金森病的重要临床依据之一。目前临床运动功能诊断通常依赖医生的专业知识和主观判断,定量化水平较差,进而导致误诊案例所占比例居高不下。针对上述问题,项目组开展了一项基于日常触屏交互行为分析的早期帕金森运动功能损伤检测方法研究。通过分析日常常见的触屏手势(如快速滑屏,图形解锁,汉字手写输入,手指捏合操作等),在速度、轨迹、压力、震颤等方面对帕金森疾病的病理特征进行了分析,提取了46维病理特征并建立识别模型。目前,该方法在由35位早期帕金森病人和67位年龄/性别相当的对照人群组成的数据集中,敏感性和特异性分别达到了0.89和0.88。该研究有望推进在日常生活中对帕金森疾病的早期预警和实时监控。

该论文作者分别为:田丰(中科院软件所),范向民(中科院软件所),范俊君(中科院软件所),朱以诚(北京协和医院),高敬(中科院软件所),王大阔(IBM Research), 毕小俊(纽约州立大学石溪分校),王宏安(中科院软件所)。

触屏手机常见操作示意图

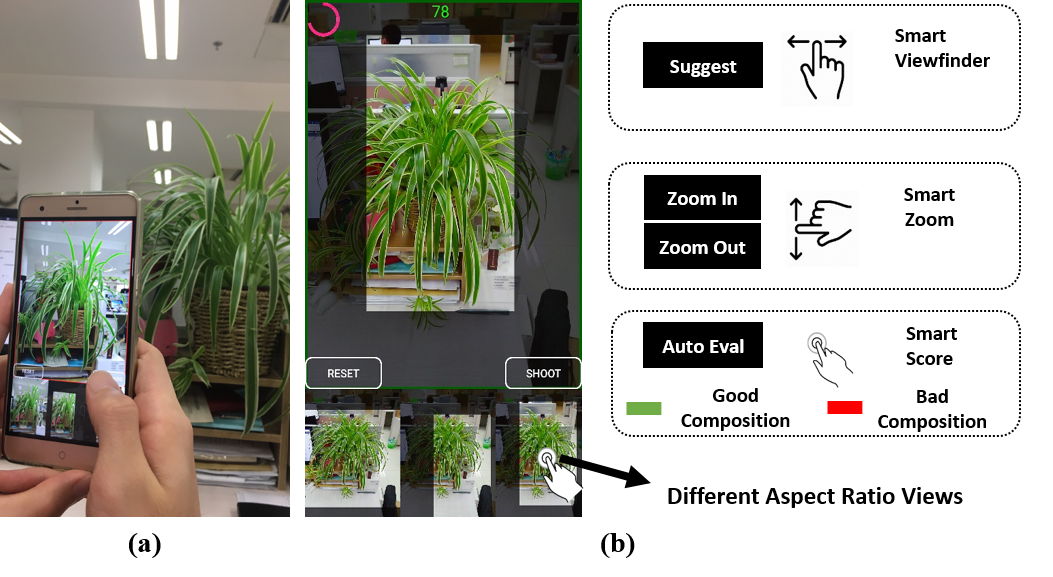

2. SmartEye: Assisting Instant Photo Taking via Integrating User Preference with Deep View Proposal Network

照片构图是一个常见但是富有挑战性的任务,人们希望拍摄出高质量的照片,然后在朋友圈、微博、推特、脸书、Ins等社交媒体上分享。然而,拍摄一张好看的照片并没有那么容易,“为什么我拍出来的照片不如别人的好看?”——不同的构图水平的人们拍摄出来的照片效果可能是天差地别的。一张好照片需要拍照的人在构图技巧方面有一定的摄影基础,但是普通人和摄影初学者可能并不具备这些技能。如何帮助非专业的用户进行实时的拍照构图呢?

该项目团队提出了一个构图推荐网络(View Proposal Network,VPN)来做到这一点,该网络由数百万张标注图像训练而来,可以接收一张照片作为输入,输入得分TopN的推荐构图,在一系列标准数据集上达到了state-of-the-art的水准。同时,该网络可以达到75+FPS的刷新率,可以满足人眼感知范围内实时推荐的需求。通过使用该网络作为Base model,设计了一个新颖的交互工具——SmartEye。它可以帮助用户实时的进行拍照和构图,并且提供了众多交互式的功能帮助用户进行探索和发掘更有趣的构图方式。

交互界面图

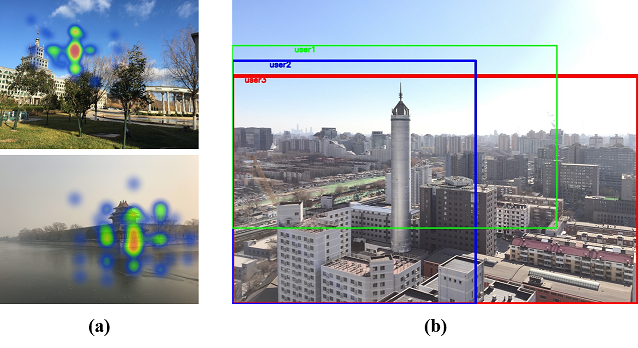

由于DeepLearning Model是由百万张Crowdsourcing标注的数据训练而来,VPN学习到的更多的是“人类”的知识,因此只能从比较宽泛的角度去考虑构图的好坏。但是照片构图是一件主观性极强的任务,审美的问题会因人而异,因此我们不得不考虑“如何将用户的偏好融合进去?”

用户之间在照片构图任务上的差异性

为了实现个性化和用户自适应,对用户偏好进行了充分的建模,项目组提出了一个用户偏好模型(PreferenceModel),该模型基于交互式机器学习(Interactive Machine Learning)的算法,可以不断迭代地从用户数据中学习到用户的偏好和习惯——“越来越符合用户的胃口”,能够做到根据用户反馈不断去调整VPN,从而更好的适应每一个用户,帮助用户拍摄出既符合构图美学又满足用户喜好的照片。我们通过计算照片构图相似度(Composition Similarity)来得到置信度(Confidence Value)从而动态调整了VPN和Preference Model在最终输出时的权重,开创性地探索了End-to-end Deep Learning Model学到的High-Level的特征知识和User preference二者如何平衡的问题,以及有效地解决了推荐任务中冷启动(Cold Start)的问题。

该论文作者分别为:马帅(中科院软件所),Zijun Wei(纽约州立大学石溪分校),田丰(中科院软件所,通讯作者),范向民(中科院软件所),Jianming Zhang(Adobe Research), Xiaohui Shen(Adobe Research), Zhe Lin(Adobe Research), 黄进(中科院软件所),Radomir Mech(Adobe Research),Dimitris Samaras(纽约州立大学石溪分校),王宏安(中科院软件所)。

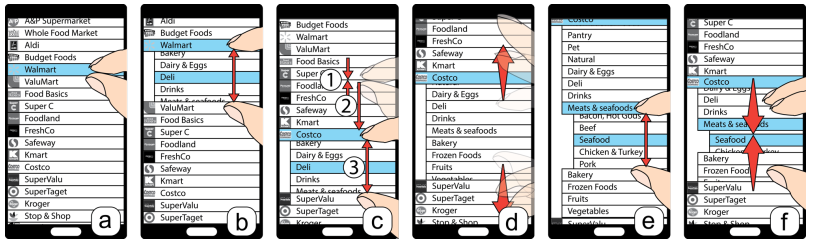

3. PinchList: Leveraging Pinch Gestures for Hierarchical List Navigation on Smartphones

在智能手机上进行分层列表的深入探索和导航是非常繁琐的任务,因为它经常要求用户频繁地在多个视图之间切换。为了克服这个限制,项目组提出了一种新颖的交互设计PinchList,它利用捏合手势来支持在分层视图中无缝探索多级列表项。使用PinchList以双指张开手势进入列表,而双指合并手势则返回到前一级别。此外,双指或三指快速捏合用于导航由两个以上级别组成的列表。并且,该研究还进行用户研究在滚动和非滚动下使用捏合/缩小手势来细化PinchList的设计参数条件,例如合适列表的尺寸和目标选择性能。同时,该研究工作还将层级导航任务中的PinchList的性能与用于列表浏览的两种常用触摸方法(分页和折叠)进行比较。结果显示,在访问分层列表视图中定位的项目时,PinchList比其他两个接口明显更快。在一系列应用演示中,PinchList取得了笔传统列表设计更好的交互体验。

该论文作者分别为:韩腾(曼尼托巴大学),刘杰(中科院软件所,共同一作),Khalad Hasan(英属哥伦比亚大学),Mingming Fan(多伦多大学),Junhyeok Kim(曼尼托巴大学),Jiannan Li(多伦多大学),范向民(中科院软件所),田丰(中科院软件所,通讯作者),Edward Lank(滑铁卢大学),Pourang Irani(曼尼托巴大学)。

PinchList操作示意图

4. Crossing-Based Selection with Virtual Reality Head-Mounted Displays

目标选择是人机交互中的一项基本任务。基于crossing范式的目标选取指的是穿越过目标的边界即可选中目标。项目组首次研究了在虚拟现实环境下基于crossing范式的目标选择交互方案,开展了使用射线在三维空间中选择目标圆盘以及在二维平面中的选择目标直线的两项实验。每项实验考虑了任务难度、运动方向限制(共线vs.正交)、任务的自然性(离散vs.连续)、虚拟现实设备的视场角以及目标深度这五种因素。实验结果表明基于crossing的目标选取方式能够很好地弥补或替代指点型选择方式;基于crossing范式的选择任务符合Fitts’ Law;目标深度对于crossing选取交互的表现有着显著影响;对于三维空间中选择目标圆盘与二维平面中选择目标直线这两类任务,用户在操作时间、错误率、Fitts模型参数等方面的表现有明显的差异。在此发现的基础上,项目组提出了虚拟现实中基于crossing范式的目标选取方式的若干指导建议。比如,远端小目标和连续目标选取时可以优先考虑crossing的方式;对于连续的交叉选择操作,目标可以与运动方向正交或者共线;对于离散的交叉选择操作,目标应尽可能与运动方向共线。

该论文作者分别为:涂华伟(南京航空航天大学),黄苏苏(南京航空航天大学),袁家斌(南京航空航天大学),任向实(日本高知工科大学),田丰(中科院软件所,通讯作者)。

实验任务示意图